[Immagine generata da Dall-e (https://labs.openai.com/) ]

(Articolo pubblicato in anteprima su AgendaDigitale.eu)

Mentre ormai tutti giocano con il nuovo enfant prodige ChatGPT e inondano i social con commenti estasiati sulle sue mirabolanti capacità, come in un’altra era si faceva con i cuccioli o i bimbi, qualcuno scrive che “ChatGPT is incredibly limited, but good enough at some things to create a misleading impression of greatness. It’s a mistake to be relying on it for anything important right now”[1].

Qualche invidioso? Non proprio, perché si tratta di Sam Altaman, il cofondatore di Open AI[2] e “papà” del piccolo prodigio ChatGPT. ChatGPT non è che l’ultimo e forse più sopravvalutato rappresentante della famiglia dei Large Language Models (LLM) che, benché strabiliante per alcuni versi, soffre ancora di una serie di limitazioni. Innanzitutto, è un’intelligenza artificiale (AI) generalista. Non nel senso che abbia raggiunto lo stadio di AGI (Artificial General Intelligence) o di Strong AI, ma piuttosto nel senso che risponde un po’ su tutto con feedback mediamente abbastanza sensati (e a volte sbagliati). Il che lo rende da un lato strabiliante, perché puoi chiedergli sia di suggerire delle modifiche per migliorare un frammento di codice Java o C# che di scrivere una poesia sul tramonto in montagna. Una risposta lui la dà sempre, come compagnoni che hanno una vasta e superficiale cultura generale e che intrattengono la compagnia chiacchierando amabilmente su qualsiasi argomento. Il meccanismo per quanto evoluto alla fine non ha nulla di magico: semplicemente il LLM di ChatGPT è molto bravo a predire statisticamente quale parola è più probabile dopo un’altra, come il suggeritore di testo che abbiamo sullo smartphone e che ci suggerisce le parole mentre scriviamo.

D’altro canto però soffre degli stessi problemi del LLM che abbiamo già visto: a volte “inventa” le cose, non fornisce elementi per valutare l’affidabilità delle informazioni, non c’è trasparenza sulle fonti e può contribuire a diffondere i pregiudizi più comuni[3]. Sui bias e sui pregiudizi ChatGPT in realtà ha fatto passi enormi rispetto ai predecessori, ma rimangono alcuni limiti, come evidenziato ad esempio dagli studi della Cornell University[4]. Senza parlare delle moltitudini di persone sottopagate che fanno il lavoro di “data labeling” per istruire le piattaforme di AI. Il MIT ha raccontato, in un magistrale articolo[5], la storia di Oskarina Fuentes Anaya e di tante persone come lei. Sono storie di sfruttamento, di compensazioni sempre tarate sul salario minimo per lo specifico paese, di pagamenti a volte non corrisposti, di notti passate ad aspettare un task meglio pagato degli altri. La solita storia di sfruttamento dei più deboli che si ripete ad ogni rivoluzione economica.

Ciò non toglie che i risultati di ChatGPT e delle nuove AI siano comunque impressionanti. Molti si stanno chiedendo: ma Google che fa? Google si trova in realtà in una situazione paradossale. Non può non investire in AI conversazionali “generali”, come ChatGPT, e infatti lo sta facendo con i vari Lambda, Sparrow[6] e Bard. Tuttavia, le AI conversazionali hanno tutte le potenzialità per soppiantare i motori di ricerca tradizionali e quindi, investendo su Sparrow, Google rischia di cannibalizzare il suo “cash cow”, ossia il motore di ricerca che genera enormi profitti tramite la pubblicità. Molti di noi stanno infatti già usando ChatGPT per tutte quelle ricerche che non necessitano di dati “freschi”, magari come primo passaggio per andare poi a raffinare la ricerca con i motori tradizionali. Ma se ChatGPT (o Sparrow, che sembra avrà queste funzionalità) fosse connesso a Internet e quindi in grado di dare risposte anche su argomenti di attualità e corredato con riferimenti e link alle fonti? Ecco, forse questo sarebbe il motore di ricerca che tutti sogniamo. E, con un motore di ricerca di questo tipo, il modello di business basato sulle pubblicità del motore di ricerca attuale di Google potrebbe non essere applicabile o dimostrarsi molto meno redditizio[7].

Ma Google sta sviluppando anche un altro filone, a mio parere persino più interessante, che riguarda le AI basate su Large Language Model “specializzati” come Med-PaLM. Se ChatGPT, senza specializzazione alcuna, è riuscito ad arrivare vicino (e in qualche caso a superarle) alle soglie per passare l’esame di abilitazione medica degli Stati Uniti (USMLE)[8], cosa potrà fare un’AI specializzata?

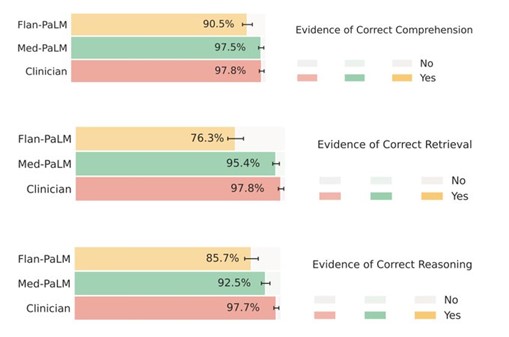

I dati forniti da Google DeepMind sulle performance di Med-PaLM ci danno una prova concreta della potenza di un LLM specializzato. Google ha verificato le risposte di Med-PaLM e del suo predecessore Flan-PaLM verificando la correttezza degli output rispetto ad un medico umano. Il risultato è che Med-PaLM ha dato le stesse risposte del medico umano nel 92,6% dei casi, contro il 61,9% di Flan-PaLM[9]. Ma c’è di più: solo il 5,8% delle risposte di Med-PaLM erano potenzialmente pericolose per il paziente. Vi sembra molto? Considerate che la percentuale di risposte potenzialmente pericolose di Flan-PaLM era del 29,7% ma, soprattutto, le risposte pericolose dei medici umani coinvolti nello studio erano del 6,5%! Quindi Med-PaLM ragiona in modo molto vicino (al 92,6%) al medico umano, ma è più sicuro. Poi bisognerebbe indagare il 7.4% dei casi in cui MedPaLM da risposte diverse dal medico umano: non è detto che siano sbagliate o necessariamente peggiori. Facendo un confronto più puntuale si vede ancora meglio quali siano gli ambiti di eccellenza di MedPaLM[10].

Quale è la differenza tra ChatGPT di OpenaAI (che pure risponde a domande in ambito medico) e MedPaLM di DeepMind (Google)? Certo sono entrambi due LLM, ma ChatGPT ha avuto una formazione “generalista”, mentre MedPaLM è stato “alimentato” con fonti selezionate e specifiche dell’ambito medico (MedQA, MedMCQA, PubMedQA, LiveQA, MedicationQA, MMLU) ed ha quindi un “DNA” diverso. Inoltre, ha avuto una importante fase chiamata “Instruction Prompt Tuning” grazie alla collaborazione con un discreto numero di medici di UK e USA. I risultati come visto sono molto incoraggianti, il che fa sperare che si tratti di successi più concreti e duraturi di quelli, ad esempio, di Watson Health (di cui IBM ha venduto alcune parti a gennaio 2022).

Vi sono poi altre AI verticali, diverse dai Large Language Model, che potremmo definire “Narrow AI” ma che sono in grado di risolvere compiti complessi con incredibile efficacia. Ad esempio le AI specializzate nell’analisi delle immagini hanno già raggiunto un’accuratezza del 94.4% negli screening sul cancro ai polmoni, facendo meglio dei medici umani in termini di accuratezza, ma con il vantaggio di poter processare in poco tempo volumi inimmaginabili per gli operatori umani[11]. Un altro esempio è quello della diagnosi delle patologie della pelle, dove Google ha rilasciato un’AI che potrebbe aiutare a limitare gli impatti della scarsità di dermatologi[12]. L’elenco sarebbe lungo, basti pensare che l’FDA ha approvato oltre 500 algoritmi di intelligenza artificiale ad uso medico[13], la maggior parte legata all’analisi delle immagini. E l’utilizzo di AI per l’analisi delle immagini diagnostiche sarà a mio parere uno dei campi più rivoluzionari in ambito sanitario nel breve periodo, sia per gli screening che per la pratica clinica generale. Il lavoro dei radiologi (e non solo) è destinato a cambiare irrimediabilmente: invece di analizzare migliaia di immagini come una macchina, il radiologo si focalizzerà sui casi dubbi e particolarmente complessi dove l’intuito e la capacità di creare collegamenti tipici dell’esperto umano faranno la differenza. Tutto il resto lo possono (e forse devono) fare le macchine.

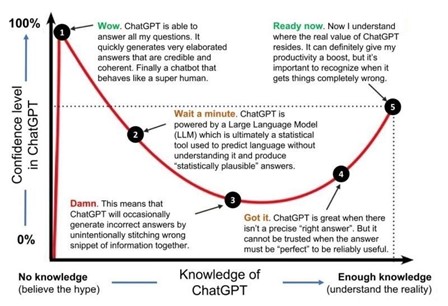

Insomma, tornando a punto di partenza ChatGPT ha avuto certamente il merito di aprire al grande pubblico una finestra sulle potenzialità dell’AI, ma certamente ora va visto con un po’ di senso critico. C’è un’immagine (presa dal grafico dell’effetto Dunning Kruger) che gira su internet (non so chi sia stato il primo ad elaborarla, se me lo segnalate lo cito esplicitamente) e che spiega bene il concetto.

Ora è il momento dei gemelli “competenti” di ChatGPT.

Siamo ad una svolta? Io penso che probabilmente siamo arrivati ad un punto di svolta qualche anno fa, con i primi modelli di “Narrow AI” specializzati nell’analisi del linguaggio e delle immagini, e non ce ne siamo accorti. Ora come abbiamo visto quei primi modelli si sono evoluti per dare risultati concreti e in molti casi con livelli di affidabilità uguali o superiori a quelli dell’esperto umano. Quando all’università negli anni ’90 studiavo i sistemi esperti sembrava un sogno, che ora si sta avverando. Le tecnologie sono diverse, si è passati dai motori inferenziali alle reti neurali, che forse non sono nemmeno lo strumento più efficace. Durante il recente WAICF (World Artificial Intelligence Cannes Festival) il Prof. Stuart Russel di Berkley ha analizzato i limiti dei LLM basati su reti neurali e predetto che probabilmente le AI del futuro sfrutteranno tecnologie diverse, come il Probabilistic Programming[14]. Quindi siamo incamminati verso le “magnifiche sorti e progressive”? Forse, ma la capacità di governo e analisi critica saranno fondamentali, così come l’integrazione di competenze. Un altro speaker dello stesso congresso, imprenditore digitale che non citerò, diceva che per affrontare le sfide che abbiamo davanti l’importante è “essere buoni, non malvagi”[15]. Era il motto anche di una delle big tech fino a qualche anno fa. Ecco, quando sento queste cose penso che se di fronte a problemi di questa portata, come il governo dell’Intelligenza Artificiale, la risposta è “facciamo i bravi”, non ci sia solo un problema di “banalità del male”, come diceva Hannah Arendt, ma anche di banalità dell’intelligenza (umana in questo caso). Ma questo è un altro tema, a cui dedicheremo forse un altro articolo. Per ora mi fermerei a quanto condiviso sulla necessità di usare lo strumento giusto per il compito giusto, consapevoli delle potenzialità e dei limiti dei diversi strumenti, intelligenti o meno. Perché ogni artefatto umano ha in qualche modo un suo “DNA”, un aspetto caratterizzante che lo rende più adatto ad alcuni compiti e meno ad altri. È importante conoscere i diversi strumenti (e oggi sono davvero tanti), comprendere e rispettare le caratteristiche di ciascuno per evitare di cadere nel vecchio detto: “all’uomo con il martello ogni problema sembra un chiodo”. O, attualizzando ad oggi, cadremmo nell’errore di usare ChatGPT per qualunque cosa. Concludo quindi con il secondo principio della vita digitale:

PRINCIPIO N.2 della VITA DIGITALE:

“Comprendi e rispetta il DNA delle tecnologie digitali per sfruttarle al meglio”

[1] “Chat-GPT è incredibilmente limitato, ma abbastanza bravo in alcune cose da creare una fuorviante impressione di grandezza. È un errore affidarsi a lui per qualcosa di importante in questo momento.” (T.d.A.)

[2] https://twitter.com/sama/status/1601731295792414720?lang=en

[3] https://the-decoder.com/openai-founder-warns-against-chatgpt-use-for-important-things/

[4] Si vedano ad esempio: https://arxiv.org/abs/2208.04417 e https://arxiv.org/abs/2101.05783

[5] https://www.technologyreview.com/2022/04/20/1050392/ai-industry-appen-scale-data-labels/

[6] https://www.wired.it/article/google-sparrow-rivale-chatgpt/?uID=97f390ebf09f9f0fdb3fff0da0d75d4966e5335989306bf3e4132e8adbc655b6&uID=e612c787935d87bb6ab52d4ce5f1945613feffb9563936254b5b441c13133334&utm_brand=wi&utm_campaign=daily&utm_mailing=WI_NEWS_Daily%202023-01-29&utm_medium=email&utm_source=news&utm_term=WI_NEWS_Daily

[7] https://www.agendadigitale.eu/cultura-digitale/competenze-digitali/digital-advertising-se-un-chat-bot-minaccia-il-titano-google-lo-scenario-alla-luce-del-caso-kodak/

[8] https://www.medrxiv.org/content/10.1101/2022.12.19.22283643v2.full

[9] https://www.marktechpost.com/2023/01/09/meet-med-palm-a-large-language-model-supporting-the-medical-domain-in-providing-safe-and-helpful-answers/

[10] https://interestingengineering.com/innovation/google-deepmind-medpalm-language-model

[11] https://www.nature.com/articles/s41591-019-0447-x

[12] https://interestingengineering.com/innovation/google-unveiled-ai-helps-diagnose-skin-conditions

[13] https://healthexec.com/topics/artificial-intelligence/fda-has-now-cleared-more-500-healthcare-ai-algorithms

[14][14] https://en.wikipedia.org/wiki/Probabilistic_programming

[15] Testualmente: “Be good, not evil”.